Aleksandr I. Panov

Директор лаборатории когнитивных ИИ систем, Москва

Руководитель Центра когнитивного моделирования, Москва

д.ф.-м.н., доцент

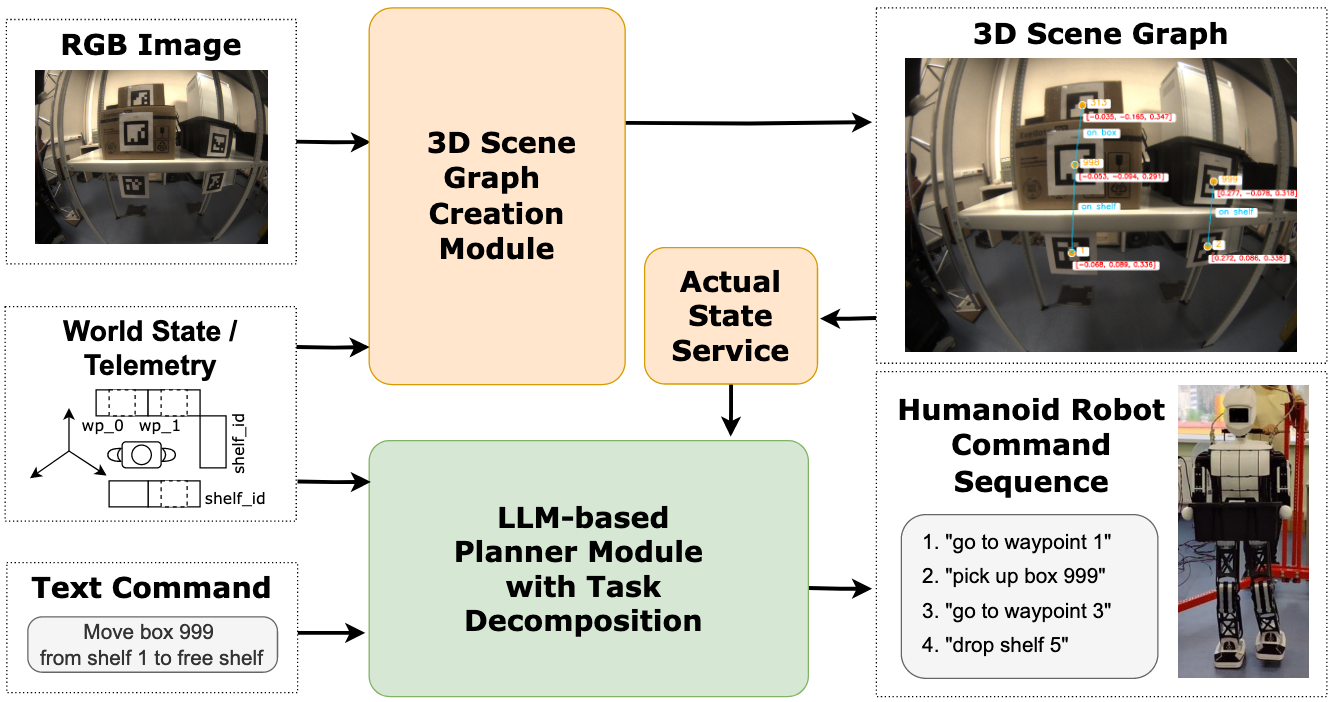

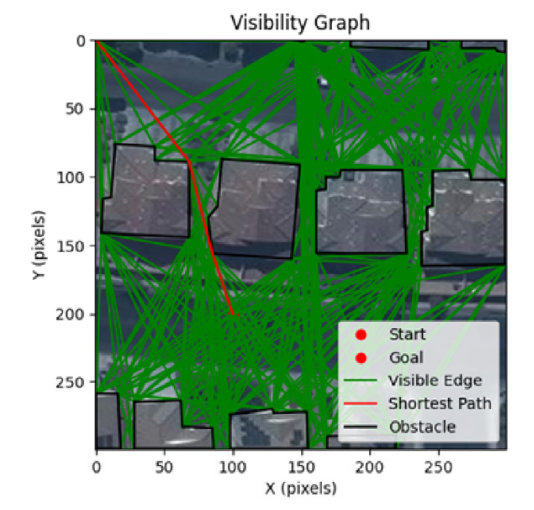

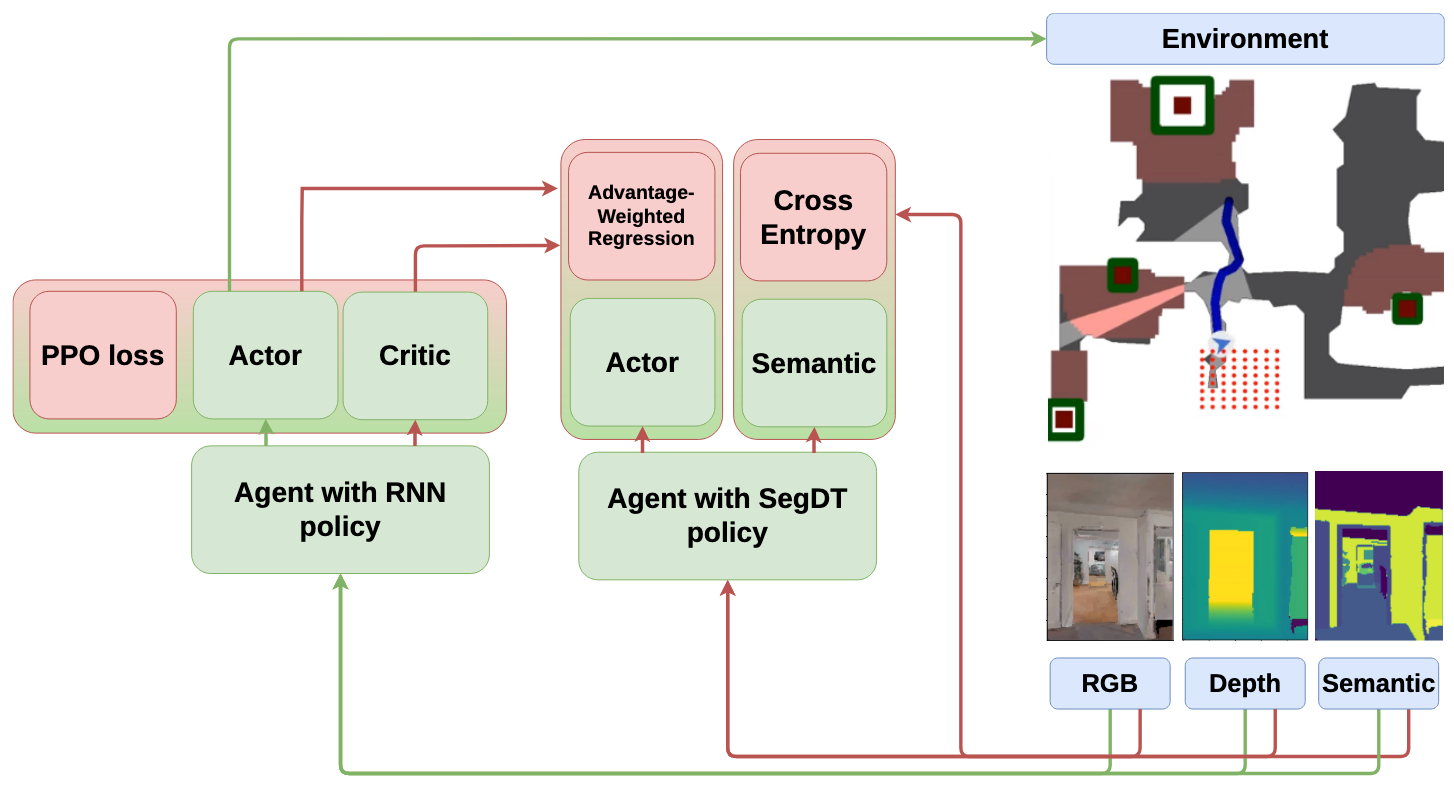

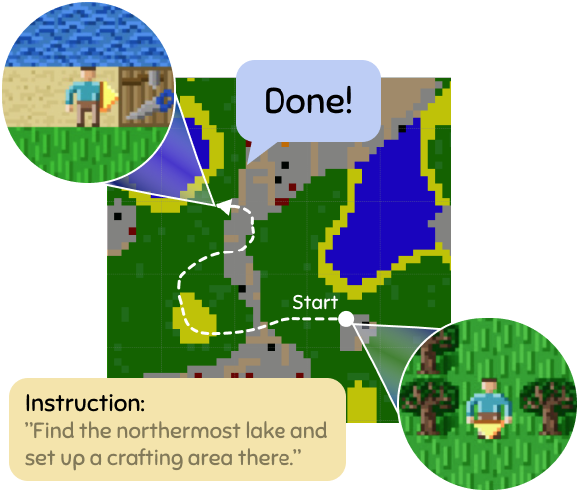

В настоящее время я руковожу лабораторией когнитивных систем искусственного интеллекта в Институте искусственного интеллекта AIRI, занимаюсь глубоким обучением с подкреплением и воплощенным искусственным интеллектом в Центре когнитивного моделирования Московского физико-технического института (МФТИ). Мои научные интересы в настоящее время связаны с трансформерными и структурированными моделям мира в обучения с подкреплением, применением языковых моделей для планирования поведения (в том числе для робототехнических платформ), мультиагентным планированием и обучением, визуальной навигацией внутри помещений. В AIRI я занимаюсь в первую очередь фундаментальными исследования по созданию новых нейросимвольных архитектур для планирования и обучения, разработкой новых архитектур LLM/VLA-агентов. В МФТИ веду прикладную деятельность и руковожу заказными научно-исследовательскими работами в области обучения с подкреплением, робототехники и систем управления. C 2019 являюсь научным руководителем прикладных исследований в области разработки систем компьютерного зрения и планирования для мобильной робототехники и беспилотного транспорта по заказу таких компаний как НКБ ВС, Интегрант, Хуавей, Сбер. Также в МФТИ являюсь научным руководителем магистерской программы по искусственному интеллекту, которая признана одной из самых востребованных академических программ в ФПМИ.

Краткая биография: В 2005 году закончил физико-математическую школу при Новосибирском государственном университете (НГУ) и затем учился в бакалавриате физического факультета НГУ со специализацией в автоматизации физико-технических исследований. Магистратуру по прикладной математике и физике закончил в МФТИ, кафедра Интеллектуальных систем (базовая кафедра Вычислительного центра РАН). Кандидатскую диссертацию выполнил в Институте системного анализа (ИСА РАН) под руководством Г.С. Осипова (тема «Исследование методов, разработка моделей и алгоритмов формирования элементов знаковой картины мира субъекта деятельности»). С 2011 по 2024 год работал в ИСА РАН (позднее вошедшем в состав Федерального исследовательского центра «Информатика и управление» РАН, ФИЦ ИУ РАН), в отделе «Интеллектуальные динамические системы и когнитивные исследования» и занимался развитием различных подходов в области обучения с подкреплением. С 2019 года руковожу Научно-образовательным центром когнитивного моделирования МФТИ и магистерской программой «Методы и технологии искусственного интеллекта» ФПМИ. В августе 2021 году присоединился к команде AIRI. В ноябре 2024 года защитил диссертацию на соискание учёной степени доктора физико-математических наук по специальности 1.2.1 “Искусственный интеллект и машинное обучение” (тема “Методы и алгоритмы нейросимвольного обучения и планирования поведения когнитивных агентов”).

Награды: В 2017 году стал лауреатом медали Российской академии наук для молодых ученых. В 2019 году был руководителем команды CDS, выигравшей первое место в соревновании NeurIPS MineRL. В 2023 году был руководителем команды SkillFusion, занявшей первое место в соревновании CVPR Habitat. Являюсь руководителем успешно завершенных грантов РФФИ и РНФ. Лауреат премии Yandex ML Prize 2024 в номинации Научные руководители. Научный консультант команды Авторобтикс, ставшей победителем технологического конкурса Up Great “5 уровень” 2024 года по беспилотным грузовым перевозкам. Номинант премии «Промышленная робототехника» 2025 в номинации «Просветитель года». Лауреат Премии правительства Москвы для молодых ученых за 2025 год в номинации «Математика, механика и информатика». В декабре 2025 года был избран Профессором РАН по отделению энергетики, машиностроения, механики и процессов управления.

Академическая работа: С 2019 года являюсь редактором журнала Cognitive Systems Research (Elsevier). С 2015 состою в Российской ассоциации искусственного интеллекта (РАИИ), до 2022 год входил в Научный совет. С 2017 года провожу ежегодные летние школы РАИИ и AIRI. В 2021 и 2022 был организатором соревнования NeurIPS IGLU. Являлся председателем направления (AC) на конференциях AAAI 2026 (AIA track), ICLR 2026, ICML 2026, NeurIPS 2026. Входил в программный комитет конференций AAAI 2023, 2024, 2025, 2026, ECAI 2023, 2024, 2025, IROS 2023, 2024, 2025, ICRA 2024, CVPR 2024, 2025, NeurIPS 2024, IJCAI 2024, ICLR 2025, ICAPS 2025, AISTATS 2025, ICML 2025, ICCV 2025 и в циклах рецензирования ACL.

новости

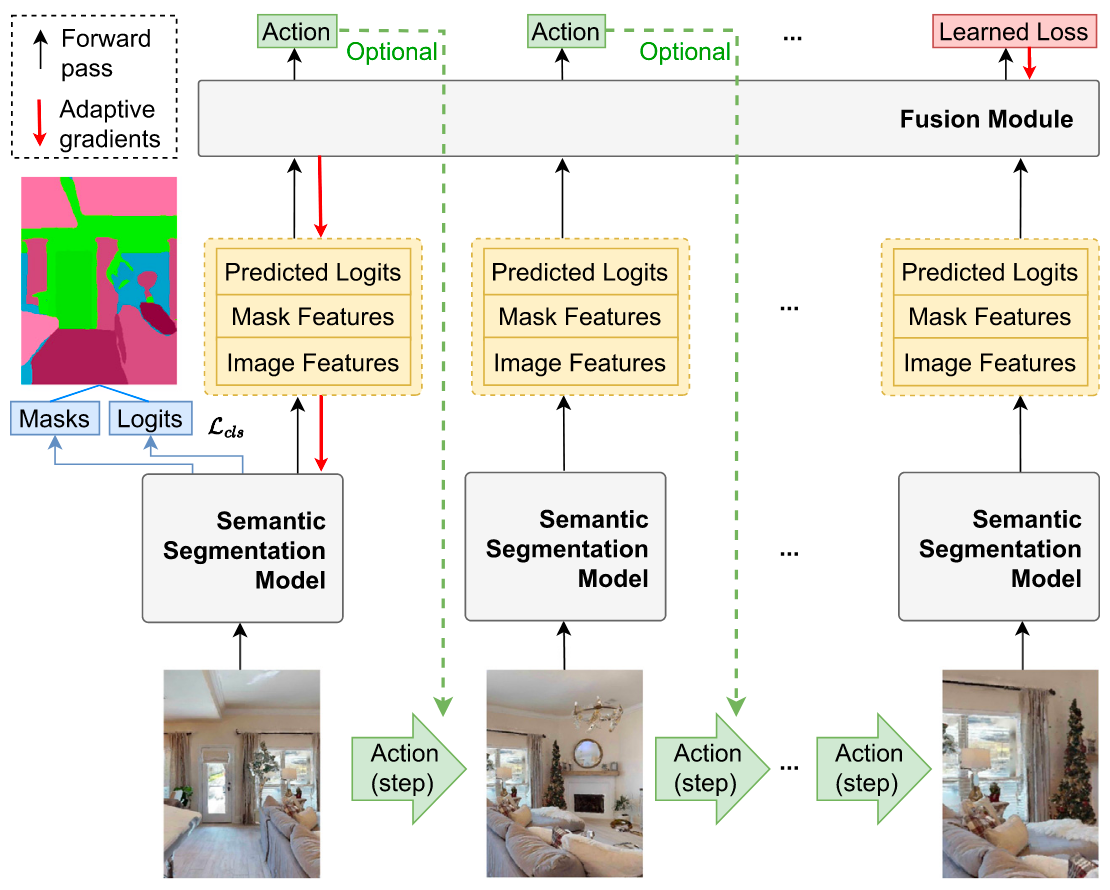

| May 6, 2026 | Our paper OVSegDT: Segmenting Transformer for Open-Vocabulary Object Goal Navigation has been accepted to CVPR 2026. |

|---|---|

| May 6, 2026 | Our paper Self-Guided Plan Extraction for Instruction-Following Tasks with Goal-Conditional Reinforcement Learning has been accepted to ACL 2026. |

| May 6, 2026 | Our paper KAGE-Bench: Fast Known-Axis Visual Generalization Evaluation for Reinforcement Learning has been accepted to ICML 2026. |

| Feb 19, 2026 | Our paper CAMAR: Continuous Actions Multi-Agent Routing received the Best Poster Award at AAAI 2026. |

| Feb 19, 2026 | Four papers from our lab have been accepted to ICLR 2026: Recurrent Action Transformer with Memory — A new architecture that integrates recurrent memory mechanisms into transformer-based offline reinforcement learning, addressing the quadratic complexity limitation of attention and improving performance on memory-dependent tasks. ELMUR: External Layer Memory with Update/Rewrite for Long-Horizon RL — A transformer-based approach with structured external memory that extends effective horizons up to 100,000 times beyond the attention window, nearly doubling performance on real robotic manipulation tasks. Unraveling the Complexity of Memory in RL Agents: an Approach for Classification and Evaluation — A systematic study proposing practical definitions and standardized evaluation methods for memory mechanisms in reinforcement learning agents. Memory, Benchmark & Robots: A Benchmark for Solving Complex Tasks with Reinforcement Learning — Introducing MIKASA, a comprehensive benchmark framework for evaluating memory capabilities in RL, including MIKASA-Robo with 32 robotic manipulation tasks. |